AI의 맹점: 도구가 스스로 가짜를 감지하지 못함

페이지 정보

본문

▶www.magandapress.com- 2025년 11월 21일 오전 10시 22분

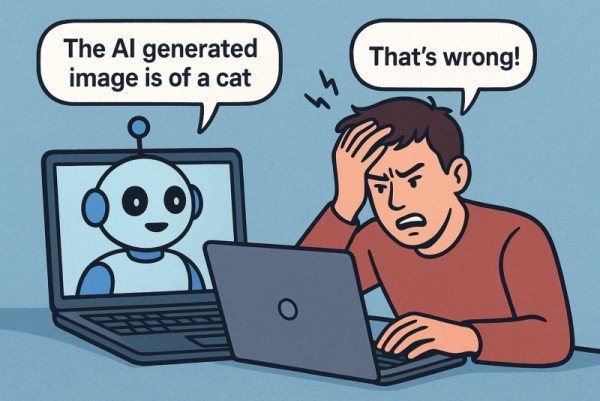

▪ChatGPT에서 생성된 일러스트레이션

[필리핀-마닐라] = 분노한 필리핀 국민들이 부패 스캔들에 연루된 의원의 바이럴 사진을 확인하기 위해 AI 기반 챗봇에 의지했을 때, 해당 도구는 이미지 자체가 생성되었음에도 불구하고 그 사진이 조작된 것인지 감지하지 못했다.

인터넷 사용자는 실시간으로 이미지를 확인하기 위해 채팅봇을 사용하는 경우가 점점 늘어나고 있지만, 이러한 도구는 종종 실패하며 주요 기술 플랫폼이 인간의 사실 확인 규모를 축소하는 시기에 시각적 폭로 기능에 대한 의문이 제기되고 있다.

많은 경우, 이러한 도구는 동일한 생성 모델을 사용하여 생성된 이미지라도 실제로는 실제 이미지로 잘못 식별하여 AI가 생성한 가짜 정보로 가득 찬 온라인 정보 환경을 더욱 혼란스럽게 만들고 있다.

그중에는 검찰이 수십억 달러 규모의 홍수 조절 부패 사기 혐의로 기소한 전직 필리핀 국회의원 엘리잘디 코의 가짜 이미지가 소셜 미디어에 유포되고 있는데, 이 사기는 재난이 잦은 이 나라에서 대규모 시위를 촉발했다.

공식 조사가 시작된 이래로 그의 행방이 알려지지 않은 코의 사진은 그가 포르투갈에 있는 것처럼 보였다. 그를 추적하는 온라인 탐정들이 구글의 새로운 AI 모드에 그 이미지가 진짜인지 물었을 때, 구글은 틀리게 진짜라고 답했다.

AFP(Agence France Presse)의 사실 확인자들은 이미지 제작자를 추적하여 해당 이미지가 Google AI를 사용하여 생성되었다는 사실을 확인했다.

AI 콘텐츠 감지 플랫폼 Copyleaks의 최고경영자(CEO)인 알론 야민은 AFP에 "이러한 모델은 주로 언어 패턴을 기반으로 훈련되었으며 AI가 생성하거나 조작한 이미지를 정확하게 식별하는 데 필요한 전문적인 시각적 이해력이 부족합니다."라고 말했다.

"AI 챗봇의 경우, 이미지가 유사한 생성 모델에서 나온 것이라 하더라도 챗봇은 종종 일관성이 없거나 지나치게 일반화된 평가를 제공하여 사실 확인이나 진위성 검증과 같은 작업에 신뢰할 수 없게 만듭니다." 구글은 AFP의 논평 요청에 응답하지 않았다.

팔로리나는 "장기적으로 AI에 맞서기 위해 AI 도구에만 의존할 수는 없다."라고 말했다. Agence France Presse 제공

댓글목록

등록된 댓글이 없습니다.